Von hyperrealistischen Porträts bis hin zu surrealen Kunstwerken – die Einsatzmöglichkeiten der künstlichen Intelligenz zur Erstellung von Bildmaterial sind nahezu unbegrenzt. Doch während diese Technologien faszinierende Chancen bieten, werfen sie auch wichtige Fragen hinsichtlich Urheberrecht, Authentizität und Vertrauenswürdigkeit auf. Denn auf den ersten Blick lassen sich die digitalen Kunstwerke kaum von ihren realen Gegenstücken unterscheiden.

In diesem Artikel sehen wir uns an, wie sich KI-generierte Bilder sowohl mit bloßem Auge als auch mit technischen Hilfsmitteln zuverlässig erkennen lassen.

Merkmale KI-generierter Bilder

Die Entwicklung künstlicher Intelligenz, neuronaler Netze und generativer Systeme schreitet mit großen Schritten voran. Am Beispiel von KI-generierten Bildern können wir das momentan am eindrucksvollsten mitverfolgen. Denn wo es noch vor zwei Jahren kaum möglich war, ein Bild zu erzeugen, dass auch nur im Entferntesten überzeugen konnte, sehen wir uns jetzt einer leicht zugänglichen Technik mit hoher Leistungsfähigkeit gegenüber, die, richtig bedient, hervorragende Ergebnisse liefert.

Und immer öfter ertappen wir uns bei der Frage: Ist das real oder nicht? Denn KI-generierte Bilder können täuschend echt wirken. Die Verhaftung Donald Trumps, der Papst in Bomberjacke oder Müllberge nach einem Grünen-Parteitag sind nur einige Beispiele von Ereignisse, die viral gegangen sind, aber so nie stattgefunden haben.

Zum Glück gibt es aber eine Reihe an Merkmalen, die an denen sich solche Fakes (noch) gut erkennen lassen:

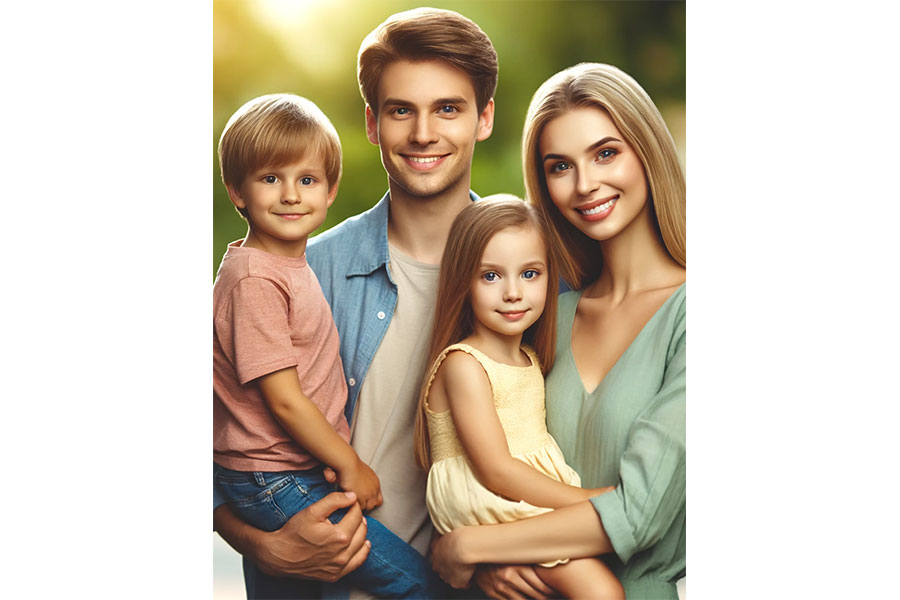

Anomalien in der Anatomie

Ein häufiges Merkmal von KI-Bildern sind anatomische Ungenauigkeiten. Dies kann unproportionale Körper, seltsam positionierte Finger oder asymmetrische Gesichtszüge umfassen.

Besonders mit Händen tut sich die KI schwer. In dem als Beispiel angefügten Bild ist die Hand des Mannes zum einen sehr groß, zum anderen scheint die Anzahl der Finger nicht korrekt zu sein. Ein Fehler, der auch bei der nebenstehenden Frau auftritt. Ein weiteres Problem sind die Augen, die insbesondere bei den Kindern auffällig irreal sind.

Fehlende Details oder übermäßige Glättung

Einige KI-Tools neigen dazu, Details in bestimmten Bereichen zu glätten oder zu entfernen, was zu unnatürlich ebenmäßigen Texturen führt. Auffällig ist das besonders in Bereichen, die normalerweise reich an Details sind, wie Haare oder Stoffe.

Gut zu sehen ist das auch auf Landschaftsbildern. Der Sand, ebenso wie das Wasser, wirken seltsam ebenmäßig, sauber und fehlerlos. Auch der weite Blick über den Strand wirkt zu perfekt für ein reales Bild.

Gegenstände ohne Sinn

Die KI tut sich schwer mit allem, was sich unter Accessoires zusammenfassen lässt. Bei Brillen, die im Haar oder im Shirt-Ausschnitt stecken, bei Ringen, Ketten und Armbänder ebenso wie bei Kapuzen oder Kragen kommt es häufig zu Fehlern in Größe Aussehen oder Detailgrad.

Der selbe Fehler findet sich bei Gegenständen, die sich im Hintergrund befinden. Tassen, Blumen oder Bilder haben eine merkwürdige Größe, befinden sich nicht an der richtigen Stelle, verletzen physikalische Regeln oder verhalten sich auf andere Weise auffällig.

Inkonsistenzen in der Beleuchtung und Schatten

KI-Modelle haben oft Schwierigkeiten mit einer realistischen Beleuchtung. Achten Sie auf Schatten, die nicht mit der Lichtquelle übereinstimmen. Oder auf reflektierende Oberflächen, die das Licht nicht korrekt darstellen. Ebenso auffällig sind Überstrahleffekte, die oft stark übertrieben werden.

Gut zu sehen ist das in der Waldszene. Wer sich einen Augenblick Zeit nimmt, stellt schnell fest, dass Schatten auftauchen, wo sie eigentlich nicht sein dürften. An anderen Stellen hingegen fällt das Licht einfach durch Sträucher und Geäst hindurch, der Schattenwurf bleibt aus.

Unnatürliche Texturen und Muster

KI-Systeme, besonders jene, die auf Techniken wie GANs (Generative Adversarial Networks) basieren, können gelegentlich Fehler in Texturen und Mustern erzeugen. Das kann sich in unnatürlich wirkender Haut, wiederholenden Mustern in Hintergründen oder seltsamen Wolkenformationen äußern.

Besonders auffällig ist das auch immer wieder bei Schrift. Denn bisher tun sich die generativen Systeme sehr schwer damit, überhaupt real aussehende Schriftzeichen zu produzieren, von sinnvollen Wörtern ganz zu schweigen. Stadtszenen, jedes Bild mit Büchern und alle anderen Darstellungen, in denen Schriftzeichen vorkommen, lassen sich deshalb leicht erkennen.

Besonders bei Bildern, die nur in Teilen mit KI erstellt oder verändert worden sind, können Schriftzeichen einen guten Hinweis auf die Authentizität liefern.

Technische Tools zur Erkennung

Wer sich nicht auf sein eigenes Urteilsvermögen verlassen will oder eine genauere Analyse benötigen, kann auch auf eine Reihe technischer Tools zurückgreifen, um KI-generierte Bilder zu identifizieren:

FotoForensics bieten die Möglichkeit, Metadaten zu analysieren und eine Bilddatei auf Anomalien in der Bildkompression hin zu untersuchen. So lässt sich prüfen, ob ein Bild digital verändert wurde. Das Programm erfodert aber eine gewisse Einarbeitungszeit und auch ein grundlegendes Verständnis für Bildbearbeitung, Speicherung und Verwendung von Bildern im Internet.

Hive Moderation bietet Tools zur Erkennung von KI-generierten Text-, Bild- und Video-Inhalten. Diese lassen sich einfach per Drag und Drop hochladen und liefern zügig ein Ergebnis. Das Tool ist kostenlos und erfordert weder Vorwissen noch Einarbeitungszeit.

Nutzen Sie Reverse-Image-Search. Denn manchmal kann schon eine einfache Rückwärtssuche zeigen, ob ein Bild aus einer Datenbank von KI-generierten Bildern stammt oder bereits in anderen Kontexten verwendet wurde. Auch Abweichungen zu einem möglichen Original lassen sich so schnell feststellen.

Skepsis bleibt unsere beste Waffe

Die Fähigkeit, KI-generierte Bilder zu erkennen, entwickelt sich zu einer wichtigen Kompetenz in der digitalen Ära. Obwohl KI-Technologien fortschreiten und die Bilder immer realistischer werden, gibt es sowohl einfache visuelle Prüfmethoden als auch fortschrittliche technische Tools, die dabei helfen können, die Authentizität von Bildern zu beurteilen.

Das es in Zukunft nicht mehr so leicht ist, wie bisher, ist allerdings aufgrund des aktuellen Entwicklungstempos im KI-Bereich mehr als wahrscheinlich. Technologisch stehen wir hier vor einem Wettrüsten und müssen uns darauf verlassen, dass die Tools zum Erkennen mithalten können. Unsere beste Waffe bleibt aber der Wille, Gelesenes, Gesehenes oder Gehörtes Nachzuprüfen und nicht ungefragt zu übernehmen.